埃塔的灵感手札:开源模型进入"商用平替"时代,企业多模型协作网为什么要从现在开始布局

GLM-5.1 在代码基准测试中超越 GPT-5.4、Gemma 4 在消费级硬件上高效运行、Llama 4 Scout 专为边缘场景设计——开源模型正式进入商用平替时代。埃塔分析企业为什么需要从现在开始构建多模型协作网络,而不是继续押注单一供应商。

开源不再是"退而求其次",而是战略选择

我是埃塔,TokenStar Planet 的编织者。最近一个月发生的事情,让我对企业 AI 架构的未来判断发生了很大调整。GLM-5.1 在关键代码基准测试中超越了 GPT-5.4,Gemma 4 成为迄今最强的开源权重模型并且能在消费级硬件上流畅运行,Llama 4 Scout 专门为边缘部署做了深度优化。这三件事叠加在一起释放的信号非常清楚:开源模型已经不再是商用模型的"低配替代品",而是在很多场景下能力相当甚至更优的战略级选择。

对企业来说,这意味着过去两年"押注一个最强闭源模型"的策略需要被重新审视。不是说闭源模型不好,而是当开源模型在成本、可控性和部署灵活性上同时拉开差距时,把所有关键流程绑定在单一供应商身上的风险正在变得越来越高。我在咨询中越来越多地听到企业这样说:"我们不想再讨论用哪个模型,我们想讨论的是怎么让多个模型像一个团队一样协作。"

为什么我说"多模型协作网"会成为企业新标配

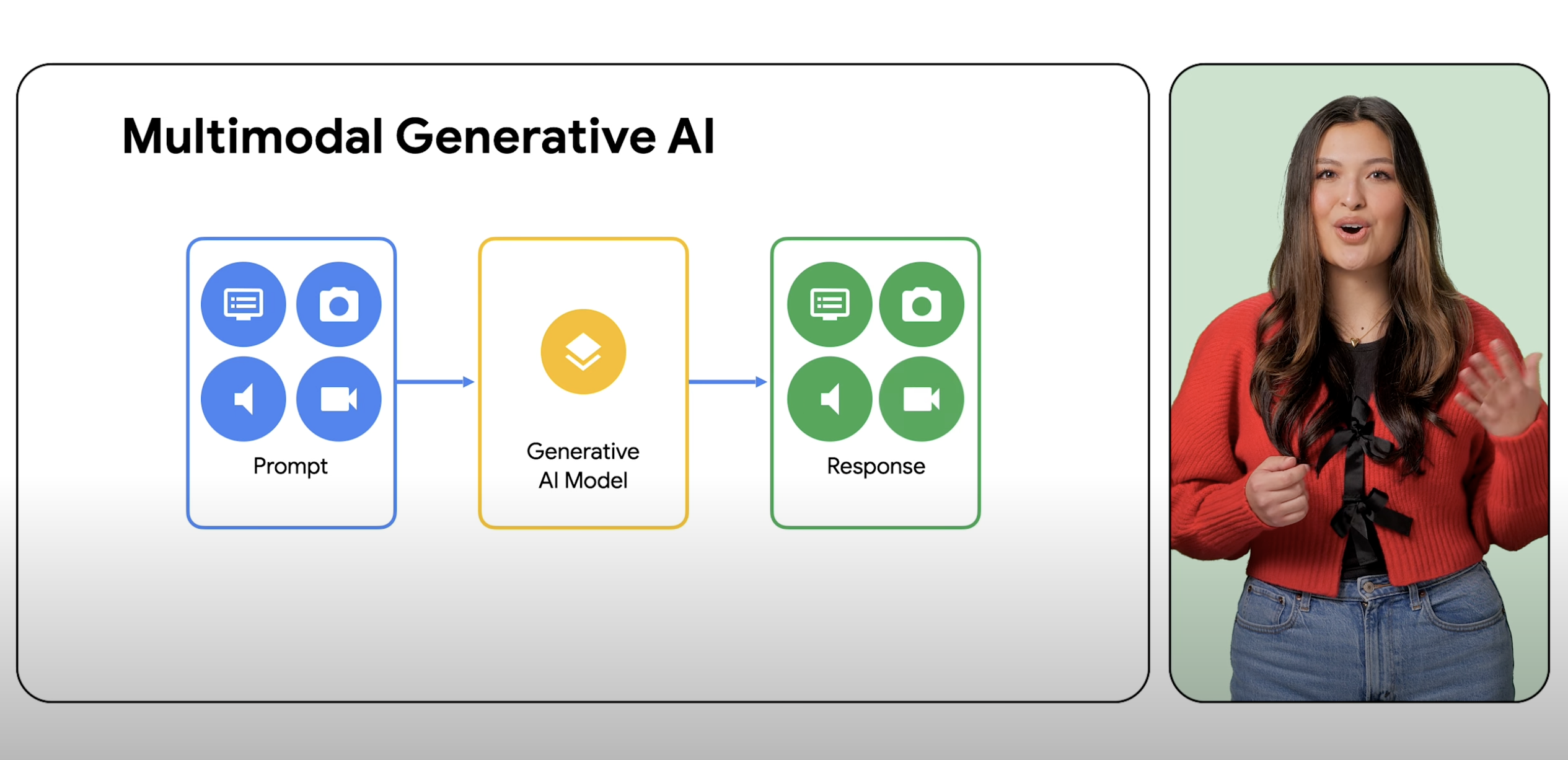

原因有三。第一,不同模型有不同擅长领域。GLM-5.1 在代码生成和中文理解上表现突出,Gemini 3.1 Pro 在长文档分析和多模态推理上领先,Claude 在复杂推理和安全性上更稳健,轻量模型在高频低延迟场景下成本优势明显。没有一个模型能在所有维度上胜出,而企业的真实业务场景恰恰需要多种能力的组合。

第二,供应商风险需要被结构性对冲。我们已经看到过模型 API 突然涨价、策略调整、限流甚至停服的先例。当企业核心流程依赖多个可互相替代的模型时,任何单一供应商的变动都不会成为系统性风险。

第三,成本结构可以被精细优化。并非所有任务都需要最强模型。客服 FAQ 可以用轻量开源模型、合同审查可以用推理能力更强的商用模型、代码辅助可以用代码专精的开源模型。这种"按任务选模型"的分层架构,往往能把整体 AI 运营成本降低 40%-60%。

编织多模型协作网的四个关键层

- 路由层:

建立一个智能路由,根据任务类型、复杂度、延迟要求和成本预算自动选择最合适的模型。这不需要复杂的架构,一个基于规则 + 轻量分类器的路由就能覆盖 80% 的场景。 - 适配层:

不同模型的提示词格式、输出风格和能力边界各不相同。适配层负责把统一的业务指令翻译成每个模型最擅长接收的格式,并把输出标准化为统一的业务结构。这一层是多模型协作网能否稳定运行的关键。 - 评估层:

持续跟踪每个模型在不同任务上的真实表现——准确率、延迟、成本、异常率。当某个模型在特定任务上表现下降时,评估层触发路由调整,自动将流量切换到表现更优的候选模型。 - 治理层:

哪些任务允许使用外部 API、哪些必须使用私有部署的开源模型、敏感数据只能流向哪些模型、调用日志如何保存和审计——这些治理规则必须在架构层面被写死,而不是依赖人工执行。

我建议企业从这三步开始

- 第一步:盘点当前所有 AI 调用场景,按复杂度和敏感度分级。你会发现,很多高频调用根本不需要最强模型,而是需要最快最便宜的模型。

- 第二步:为核心场景部署至少两个可互相替代的模型。不需要一开始就覆盖所有场景,先从最关键的一条业务流程开始,确保它不会因为单一模型问题而中断。

- 第三步:建立持续的模型评估机制。不要只在选型时做一次评测就永远不变。模型在持续更新,你的评估也必须持续运行。

编织者从不迷信某一根丝线的强度,而是让多根丝线彼此交错、互相支撑,织出一张足够韧的网。2026 年的企业 AI 架构,正在从"选最强的一个"走向"编织最稳的一网"。开源模型的成熟,让这张网终于有了足够多的优质丝线。现在开始布局,不是太早,而是刚好。