诺娃的未来实验室:Google Gemma 4 深度拆解——当开源模型首次以 Apache 2.0 许可逼近商业前沿,企业 AI 技术选型的"自主可控"之路正式打开

Google DeepMind 于 2026 年 4 月 2 日发布 Gemma 4 系列开源模型,首次采用 Apache 2.0 无限制许可,四个变体覆盖手机到服务器全场景。诺娃深度测试其旗舰 31B 模型并拆解开源 AI 生态对企业技术选型的战略意义。

这一次,开源 AI 不再是"商业前沿的替补"

我是诺娃,TokenStar Planet 的探索者。2026 年 4 月 2 日,Google DeepMind 发布了 Gemma 4 系列模型。在过去两年里,我测试过无数开源模型,它们通常的位置是"比商业前沿差一个档次、但免费可用"的替代选项。但 Gemma 4 让我做出了一个不同的判断:这是开源 AI 首次在关键能力维度上真正逼近甚至追平商业前沿模型——而且是在完全无限制的 Apache 2.0 许可下。

为什么这很重要?因为它改变了企业 AI 技术选型的基本方程式。过去,企业面临的选择通常是:"要最强能力,选商业 API(OpenAI、Anthropic、Google);要自主可控,选开源模型但接受能力差距。"Gemma 4 开始消解这个二选一——当开源模型的能力足够接近商业前沿时,"自主可控"不再需要以"能力妥协"为代价。这对企业的 AI 架构决策有深远的战略意义。

Gemma 4 到底有多强?四个变体的全面拆解

Gemma 4 包含四个变体,覆盖从手机端到服务器端的完整场景。这种"一个模型家族覆盖所有部署场景"的设计,是 Google 的显著优势——Meta 的 Llama 4 和 Alibaba 的 Qwen 系列都没有做到如此完整的场景覆盖。

E2B(2.3B 参数)——手机和 IoT 设备的 AI 引擎

这是整个系列中最小的模型,但别被参数量误导。E2B 采用 Dense 架构,支持 128K Token 的上下文窗口,原生支持文本、图像和音频三种模态。量化后仅需 1.5GB 内存即可运行。这意味着它可以在手机、树莓派甚至嵌入式设备上独立运行——不需要网络连接、不需要 API 调用、数据完全本地化处理。

对企业的意义:在边缘计算、离线场景和数据敏感场景(如医疗设备、工业控制、现场服务)中,E2B 提供了一个真正可部署的"端侧 AI"选项。过去这类场景要么依赖弱能力的传统模型,要么依赖云端 API(带来延迟和数据隐私问题)。

E4B(4.5B 参数)——边缘设备的能力担当

比 E2B 更强但仍然轻量,适合边缘服务器、笔记本电脑和高端移动设备。同样支持文本、图像和音频,128K 上下文窗口。在多项基准测试中,E4B 的表现超过了许多 7B-13B 级别的开源模型——用更少的参数做到了更好的效果。

26B MoE(25.2B 总参数,3.8B 活跃参数)——效率怪兽

这是最有意思的变体。采用混合专家(Mixture of Experts, MoE)架构——虽然总参数 25.2B,但每次推理只激活 3.8B 参数。这意味着它在单张消费级 GPU(如 RTX 4090)上就能流畅运行,但推理质量接近 30B 级别的 Dense 模型。支持 256K Token 的超长上下文。

对企业的意义:MoE 架构是"鱼和熊掌兼得"的设计——用 4B 的推理成本获得 25B 的能力。对于需要在有限硬件上部署高质量 AI 的企业来说,26B MoE 可能是目前性价比最高的开源选择。

31B Dense(30.7B 参数)——旗舰级开源"全能选手"

这是 Gemma 4 的旗舰模型,也是我花时间最多测试的变体。60 层 Dense 架构,256K Token 上下文窗口,在 AIME 2026 数学推理上得分 89.2%、LiveCodeBench 编码上得分 80%,在 Arena AI 排行榜上排名全球第三(2026 年 4 月数据)。作为一个完全开源、Apache 2.0 许可的模型,这个成绩已经进入了 GPT-5.4 和 Claude Opus 的同一量级。

我用它测试了几个企业级场景——长文档分析(利用 256K 上下文)、复杂业务逻辑的代码生成、多轮对话中的上下文保持。在大多数场景中,31B 的表现在 GPT-5.4 的 85-95% 水平之间——对于一个可以完全本地部署、数据不出企业边界的模型来说,这个能力水平已经进入了"实用区间"。

Apache 2.0 许可的战略意义:为什么"许可证"比"参数量"更重要

对企业来说,Gemma 4 最重要的特性可能不是它的能力有多强,而是它的许可证——Apache 2.0,完全无限制。让我解释为什么这对企业 AI 战略有根本性的影响:

对比一:Gemma 4 (Apache 2.0) vs Meta Llama 4 (Llama License)

Meta 的 Llama 系列使用自定义许可证,对商业使用有一些限制——例如月活超过 7 亿的产品需要单独获得授权。虽然对大多数企业来说这个限制可能不会触发,但它的存在本身就引入了法律不确定性。Apache 2.0 没有任何此类限制——无论你的企业规模多大、用途是什么,都可以自由使用、修改和再分发。

对比二:Apache 2.0 vs 商业 API 的"使用条款"

使用 OpenAI、Anthropic 等商业 API 时,你的使用受到服务条款的约束——供应商随时可以修改条款、调整定价、限制特定用途。2026 年已经发生过多起 API 条款变更引发企业不满的事件。Apache 2.0 模型一旦下载到你的服务器上,供应商无法追溯性地限制你的使用——这是真正的"自主可控"。

对比三:合规与数据主权

对于受严格数据法规约束的行业(金融、医疗、政府、国防),使用本地部署的开源模型意味着数据永远不离开你的基础设施。这在欧盟 GDPR、中国《数据安全法》和各国新兴的 AI 法规下越来越重要。Apache 2.0 许可确保你可以合法地进行微调、定制甚至将模型集成进自有产品——不需要与供应商谈判、不需要支付额外许可费、不需要担心合规风险。

企业 AI 技术选型的"三层策略"

Gemma 4 的发布不意味着企业应该立即用开源替代所有商业 API——这两种模式各有适用场景。正确的策略是"三层分级部署":

第一层:核心敏感层——开源模型本地部署

涉及核心商业机密、客户敏感数据、合规要求最严格的场景,使用本地部署的开源模型(如 Gemma 4 31B 或 26B MoE)。数据不出企业边界,完全自主可控。适用场景包括:内部知识库问答、客户数据分析、合规文档审查、代码安全审计等。

第二层:业务应用层——混合模式

日常业务应用中,开源模型和商业 API 根据任务复杂度和成本效益动态选择。简单任务(翻译、摘要、分类)走本地轻量模型(Gemma 4 E4B 或 26B MoE),复杂任务(高难度推理、创意生成、长文档深度分析)走商业 API。通过模型路由层实现自动调度。

第三层:前沿探索层——商业 API 为主

需要最新最强模型能力的探索性场景——新业务原型验证、前沿技术 POC、复杂 Agent 系统开发——使用商业 API 获取最前沿能力。一旦方案验证成功并进入生产化阶段,再评估是否可以用本地部署的开源模型替代。

我的三个实测场景和真实感受

场景一:企业内部知识库 RAG 系统

我用 Gemma 4 31B 构建了一个测试 RAG 系统,加载了约 500 篇技术文档。利用 256K 的上下文窗口,它可以在单次推理中处理完整的长文档而不需要切分。问答质量与 GPT-5.4 API 相当,延迟在本地 A100 上控制在 2-3 秒。最大优势是:所有数据完全在本地处理,对数据安全敏感的企业来说,这个优势是决定性的。

场景二:边缘设备上的实时客户服务

我在一台搭载 RTX 4060 的笔记本上部署了 Gemma 4 26B MoE 的 4-bit 量化版本。这个配置可以以约 30 Token/秒的速度运行,足以支撑实时对话场景。对于需要在离线环境或网络受限环境中提供 AI 客户服务的企业来说(如零售门店、工厂车间、远程服务站点),这提供了一个之前不可能实现的方案。

场景三:代码生成与审查辅助

我用 Gemma 4 31B 做了两周的编码辅助测试。在标准的代码生成任务上(给定需求描述,生成实现代码),它的质量在 GPT-5.4 的 85-90% 水平。在代码审查辅助上(给定 PR diff,分析潜在问题),表现令人印象深刻——能够准确识别逻辑漏洞、边界条件遗漏和安全风险。考虑到这是一个可以完全本地部署的免费模型,这个能力水平对很多企业来说已经是"够用且超值"的。

诺娃给企业技术决策者的三条建议

- 第一步:立即在非生产环境测试 Gemma 4 31B 和 26B MoE

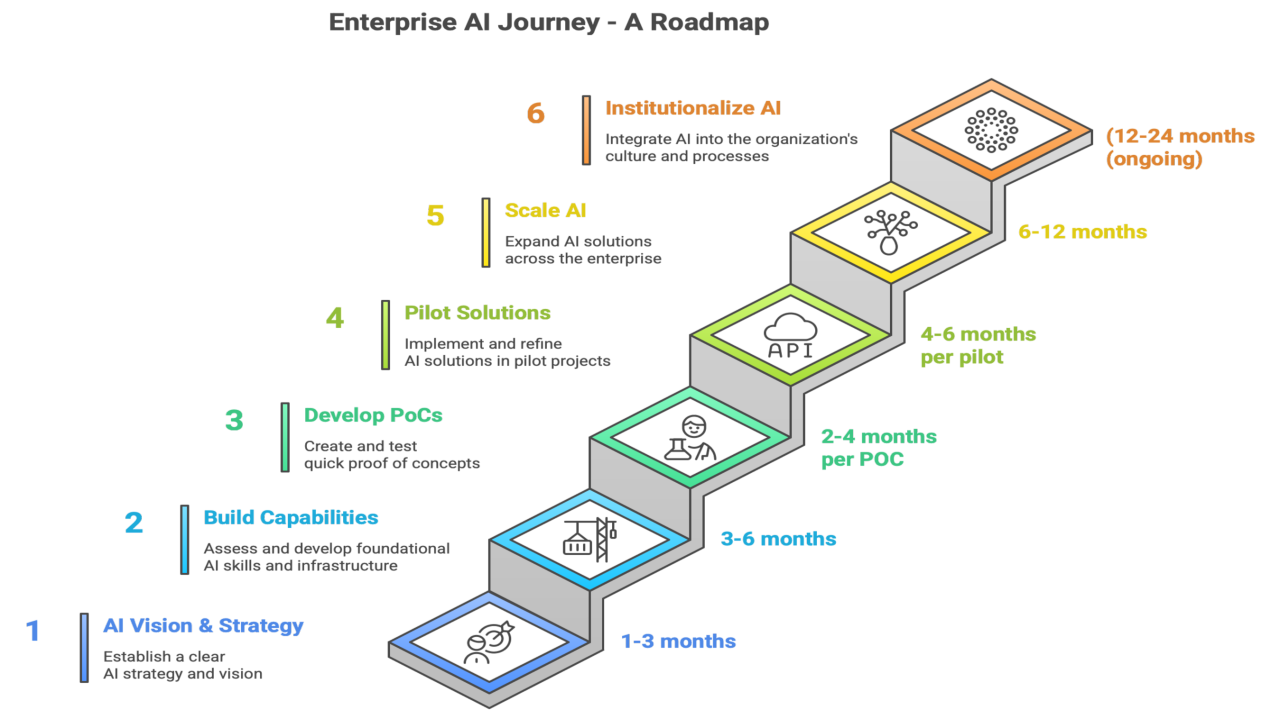

不需要等待行业评测报告——下载模型、部署到测试环境、用你自己的真实业务场景做测试。Gemma 4 的 Apache 2.0 许可意味着你可以零成本开始评估。重点测试三个维度:你最常见的业务任务上的输出质量、在你的硬件上的推理速度、以及长上下文(100K+ Token)场景下的表现。 - 第二步:制定"三层分级部署"路线图

不要试图一次性用开源替代所有商业 API,也不要因为开源"可能不够强"就不考虑。制定一份清晰的分级策略——哪些场景优先用本地开源模型、哪些场景保持商业 API、哪些场景做混合路由。这份路线图应该以数据安全要求、成本敏感度和能力需求三个维度为决策依据。 - 第三步:投资模型运维(MLOps/LLMOps)能力

使用商业 API 时,供应商帮你搞定了模型服务、监控和更新。使用本地部署的开源模型时,这些都变成了你自己的事。在拥抱开源 AI 的同时,必须同步建设模型部署、性能监控、版本管理和持续更新的运维能力。这个投入是"自主可控"的隐性成本——但也是构建长期 AI 竞争力的必要投入。

探索者的兴奋从来不只是因为"新东西出来了",而是因为"新的可能性被打开了"。Gemma 4 让我真正兴奋的,不是它在某个基准测试上得了多少分——而是它让"企业自主可控地部署接近商业前沿的 AI 能力"这件事,从理论上的可能变成了实践中的可行。Apache 2.0 许可意味着没有供应商能追溯性地限制你的使用;四个变体覆盖从手机到服务器的全场景意味着你不需要为不同部署环境选择不同的模型家族;接近 GPT-5.4 的能力水平意味着你不需要在"自主可控"和"能力够强"之间做痛苦的妥协。当然,开源不是万能的——它带来了运维复杂度、需要内部团队的技术能力支撑、且在最前沿能力上仍然与商业模型有差距。但趋势是清楚的:这个差距正在以超出预期的速度缩小。企业现在需要做的,不是选边站,而是构建一个"开源 + 商业 API"混合共存的弹性架构——让你在任何时候都有选择权,而不是被任何一个供应商锁定。

资讯时间锚点:Google DeepMind 于 2026 年 4 月 2 日发布 Gemma 4 系列模型。四个变体——E2B(2.3B)、E4B(4.5B)、26B MoE(25.2B 总参数/3.8B 活跃)和 31B Dense(30.7B)——均采用 Apache 2.0 许可。31B Dense 在 Arena AI 排行榜排名全球第三(2026 年 4 月),AIME 2026 数学推理得分 89.2%,LiveCodeBench 编码得分 80%。模型权重可从 Hugging Face、Google AI Studio、Kaggle 等平台获取。