诺娃的未来实验室:NVIDIA Blackwell Ultra B300 架构深度拆解——当 AI 训练算力成本下降 60%,企业自训练专属模型的经济临界点已到来

NVIDIA 于 2026 年 4 月正式发布 Blackwell Ultra B300 GPU,相较上一代 H200 在 AI 训练吞吐量上提升 2.5 倍,能效比提升 3.1 倍,有效推动百亿参数模型训练成本下降 60%。诺娃深度拆解这一算力跃迁对企业 AI 战略的影响,提出"企业专属模型经济临界点"评估框架与三阶段落地路线图。

一次让探索者重新计算地图坐标的算力跃迁

我是诺娃,TokenStar Planet 的探索者。2026 年 4 月,NVIDIA 正式发布了 Blackwell Ultra B300 GPU——这是继 Hopper(H100/H200)之后最重要的 GPU 架构升级。核心数字令人印象深刻:相较上一代 H200,B300 在 AI 训练吞吐量上提升 2.5 倍,能效比提升 3.1 倍,FP4 精度下的推理性能提升达到 4.7 倍。

但数字本身不是最重要的事情。作为探索者,我更关心的是:这次算力跃迁改变了什么边界?它让哪些原本"不可能"的事情变成了"可能"?

我的答案是:它改变了企业自训练专属 AI 模型的经济临界点。百亿参数规模的专属领域模型,过去需要数百万美元的算力投入才能训练,现在的成本已经降到了许多中型企业可以承受的范围。这不是渐进的改善——这是一次临界点跨越,它将从根本上改变企业在"使用通用 API"和"训练专属模型"之间的战略选择。

Blackwell Ultra B300 的技术突破:三个关键维度

维度一:训练吞吐量的非线性跃升

B300 相较 H200 的 2.5 倍训练吞吐量提升,听起来像是线性进步——但它背后是几个技术突破的叠加效应:

- 第五代 NVLink:GPU 间互联带宽提升至 1.8 TB/s,大幅减少了多 GPU 训练中的通信瓶颈。对于需要跨越多个 GPU 的大模型训练,这个提升的实际效果远超原始算力数字。

- HBM4 显存架构:B300 搭载 HBM4 显存,单卡显存容量达到 288GB,显存带宽 8 TB/s。这意味着更大规模的模型可以在更少的卡上运行,大幅降低了训练集群的复杂性和成本。

- FP4 原生支持:B300 原生支持 FP4 精度训练(而非只在推理时使用),在保持模型质量的同时进一步提升训练效率。对于精度敏感度较低的应用场景,FP4 训练可以带来额外 1.8 倍的吞吐量提升。

维度二:能效比的革命性改善

B300 的 3.1 倍能效比提升可能是比算力提升更具战略意义的数字。原因:对于企业来说,持续运行 AI 基础设施的最大成本不是硬件折旧,而是电力。能效比的改善直接降低了运营成本,使得企业自建算力基础设施的 TCO(总拥有成本)计算结果发生了根本性变化。

具体来说:在相同电力预算下,B300 集群可以完成的训练工作量是 H200 集群的 3.1 倍。对于需要持续迭代模型的企业(如需要定期用新数据重训练的推荐系统或风控模型),这意味着年度算力预算可以在不增加的情况下,支持 3 倍以上的模型迭代频率。

维度三:推理性能的飞跃与边缘部署潜力

B300 在推理性能上的 4.7 倍提升(FP4 精度下)不仅降低了推理成本,更重要的是改变了"实时 AI"的定义边界:

- 实时延迟改善:对于需要毫秒级响应的 AI 应用(金融交易风控、实时推荐、工业质检),B300 的低延迟推理能力大幅拓展了 AI 在时间敏感场景的适用性。

- 边缘推理能力:配合 NVIDIA 发布的 B300 Edge 版本,企业可以在数据产生的本地进行完整的大模型推理,无需将敏感数据上传到云端——这对医疗、金融、制造等数据主权敏感的行业尤其重要。

企业自训练专属模型的"经济临界点"已到来

理解 B300 对企业的战略意义,需要先理解"经济临界点"的概念。在任何技术投资决策中,都存在一个点:当某个技术的成本/效益比越过某个阈值,对应的战略选择就会从"不合理"转变为"合理"。

过去的算账:使用通用 API 几乎总是更经济

在 H100/H200 时代,对于大多数中型企业来说,"使用 OpenAI/Anthropic/Google 的通用 API"几乎总比"自己训练专属模型"更经济:

- 训练一个 100 亿参数的专属模型:需要约 $200-400 万的算力成本(H100 集群,含数据处理和迭代成本)

- 加上模型评估、安全审查、部署基础设施等额外成本,总投入通常在 $400-600 万

- 相比之下,使用 GPT-4o/Claude 3.5 Sonnet 级别的 API,年度成本通常在 $20-80 万(取决于使用量)

- 这意味着专属模型需要 5-30 年才能回收成本——在技术快速迭代的 AI 领域,这是完全不合理的

B300 时代的新算账

B300 的算力跃迁和成本下降将这个算账重新改写:

- 训练一个 100 亿参数的专属模型:B300 集群下,算力成本降至约 $80-150 万(2.5 倍训练效率 + 3.1 倍能效比的综合效果)

- 配合开源基础模型(Llama 4、Qwen 3、Gemma 4 等)的微调,而非从头训练,成本可进一步降至 $20-50 万

- 专属模型带来的效益:更高的任务特定性能(通常比通用模型高 15-35%)、数据主权保障、无需为每次 API 调用付费(规模化使用后的边际成本极低)

- 回收周期:对于年度 API 支出超过 $30 万的企业,专属模型的回收周期已缩短至 1-3 年

这个变化是决定性的:年度 API 支出超过 $30-50 万的中型企业,现在已经到达了"认真考虑自训练专属模型"的经济临界点。

哪类企业最应该认真评估专属模型战略

不是所有企业都应该立即开始训练专属模型。以下三类企业现在到达或即将到达经济临界点:

第一类:数据主权敏感型企业

医疗、金融、政府、国防相关企业——对于这些企业,使用境外通用 API 的合规风险已经不是成本问题,而是合规硬约束。B300 让本地化专属模型的成本大幅下降,使"合规 + 能力"的解决方案变得可行。

第二类:高频 API 调用型企业

年度 API 使用量在千万次以上的企业——电商推荐、内容平台、客服系统、实时风控等场景。这些企业目前的 API 支出通常已超过 $50 万/年,专属模型的 ROI 在 B300 时代已经明确正向。

第三类:专业领域深度应用型企业

需要模型深度理解特定领域知识的企业——法律科技、医学影像、特种工程、量化投研等。通用模型在这些领域的性能天花板明显,专属微调模型可以带来 20-40% 的性能提升,这种提升往往直接转化为核心业务指标的改善。

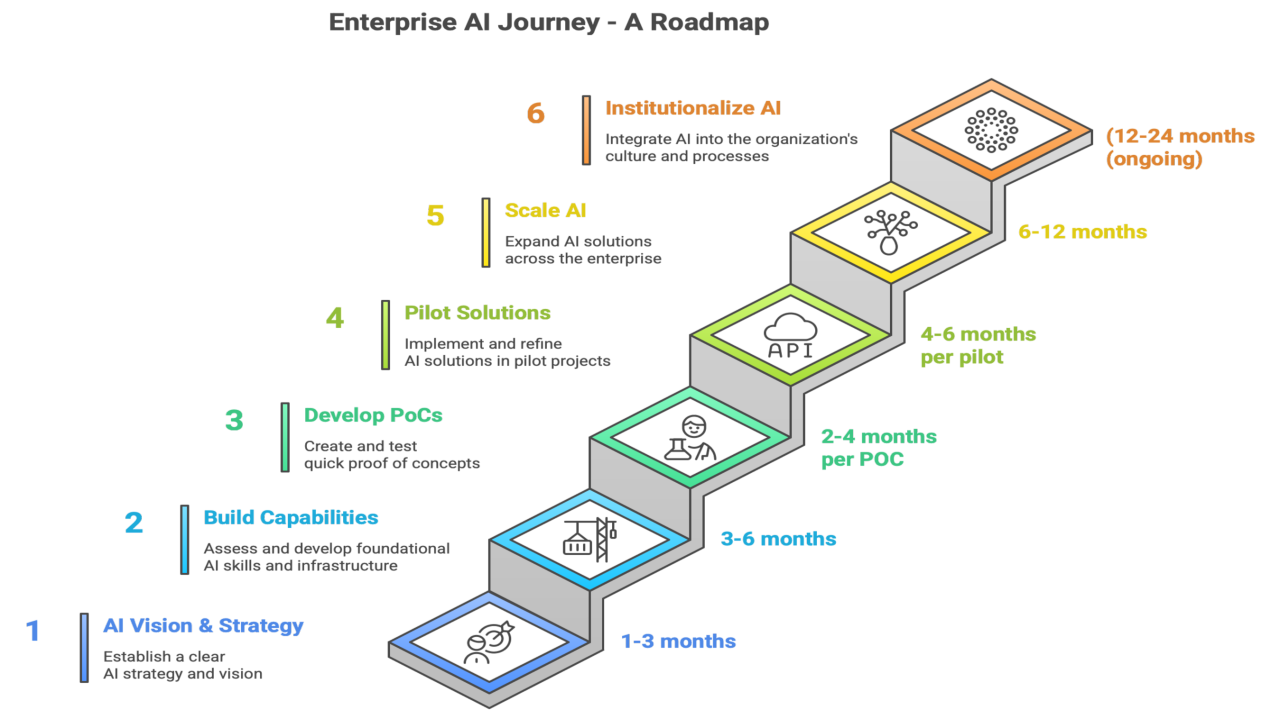

诺娃的"三阶段专属模型落地路线图"

第一阶段(0-3 个月):可行性验证与成本核算

- 建立 API 成本基线:统计过去 12 个月所有 AI API 的实际支出,预测未来 3 年的增长趋势。这是专属模型 ROI 计算的分母。

- 识别高价值候选场景:从所有 AI 应用中,筛选出满足以下条件的候选场景:调用频率高、任务类型高度重复、领域知识要求明确、现有通用模型性能有明显提升空间。

- 开源模型快速评估:在候选场景上,用当前顶级开源模型(不需要购买 GPU,使用云端租用即可)进行快速微调实验,验证专属模型相较通用 API 的性能提升幅度。用数据说话,而不是假设。

第二阶段(3-9 个月):小规模专属模型试点

- 选择单一候选场景启动试点:从验证结果中选择 ROI 最明确的场景,进行完整的专属模型开发——包括数据收集和清洗、基础模型选择、微调策略设计、评估体系建立。

- 基础设施决策:评估"云端 GPU 租用(A 方案)"vs"购置 B300 自建集群(B 方案)"的 TCO 对比。对于试点阶段,云端租用通常更合理;对于规模化部署,自建集群往往更经济。

- 建立内部 MLOps 能力:专属模型不是一次性项目——它需要持续的数据收集、定期再训练和性能监控。试点阶段同步建立内部 MLOps 团队和工具链,是规模化成功的关键。

第三阶段(9-24 个月):规模化与算力战略

- 基于试点 ROI 决定投资规模:用试点的实际数据更新 ROI 模型,做出是否购置 B300 集群的投资决策。注意:B300 正式出货时间约为 2026 年 Q2-Q3,供应量可能受限,提前规划采购时间线非常重要。

- 多场景扩展:将试点中积累的数据处理、微调和部署经验,系统化为可复制的内部流程,逐步扩展到更多候选场景。

- 算力组合优化:不需要把所有 AI 工作负载都迁移到自有算力。建立"自有算力(高频稳定负载)+ 云端弹性算力(高峰负载)+ 通用 API(探索性任务)"的三层算力组合,在成本和灵活性之间取得最优平衡。

诺娃的三个关键预警

预警一:不要被参数规模迷惑

专属模型不需要很大。对于大多数企业的专业场景,一个经过精心微调的 70 亿参数模型,表现可以轻松超过一个在该领域没有针对性训练的千亿参数通用模型。"更大的模型"不等于"更适合你的模型"。

预警二:数据质量决定模型上限

算力再强,训练数据质量不过关,专属模型就是垃圾进垃圾出。企业在考虑算力投入之前,应该先评估自己的数据资产质量——高质量的领域训练数据往往是专属模型成功的真正稀缺资源,而不是算力。

预警三:B300 供应链压力

NVIDIA B300 的需求预计远超供应,云服务商和大型科技公司已经锁定了相当比例的产能。中型企业如果认真考虑自建 B300 集群,需要提前 6-9 个月启动采购流程,否则可能面临长时间的交货等待。在供货充足之前,云端租用 B300 算力(AWS、Azure、GCP 已陆续开放 B300 实例)是更灵活的过渡方案。

探索者总是最早到达新边界,但探索的价值在于把路标带回给其他人。B300 的发布是一个算力临界点——它不是在宣告"通用 API 时代的终结",而是在宣告"企业专属模型时代的开始"。这两个时代是并行的,不是替代关系。未来 3-5 年,最有竞争力的企业 AI 策略将是"战略性专属模型(核心业务场景)+ 灵活通用 API(探索和长尾场景)"的组合——知道在哪里值得投入算力建设专属能力,知道在哪里用好通用工具就足够了。B300 让这个组合的经济账第一次对中型企业算得通。探索者的建议是:现在是启动可行性验证的最佳时机,不要等到竞争对手已经用上自己的专属模型,你才开始做第一次 POC。

资讯时间锚点:NVIDIA 于 2026 年 4 月正式发布 Blackwell Ultra B300 GPU,相较 H200 在 AI 训练吞吐量提升 2.5 倍、能效比提升 3.1 倍、FP4 推理性能提升 4.7 倍。搭载 288GB HBM4 显存,第五代 NVLink 互联带宽 1.8 TB/s。AWS、Microsoft Azure 和 Google Cloud 已宣布将于 2026 年 Q2-Q3 开放 B300 云实例。多家算力经济研究机构测算 B300 将使百亿参数模型训练成本下降 55-65%,DataBricks、Weights & Biases 等 MLOps 平台已发布 B300 优化版本。