图思达的远望日记:Anthropic RSP v3.0 深度解读——当 AI 安全标杆公司放弃硬性安全承诺,企业 AI 供应商信任评估体系必须重构

Anthropic 于 2026 年 2 月发布 RSP v3.0,取消了硬性安全阈值暂停承诺,转向透明度驱动的弹性治理框架。图思达深度分析这一变化对企业 AI 供应商信任评估的冲击,提出"四维信任评估矩阵"与 60 天供应商安全审计路线图。

一个让守护者不安的转折:AI 安全的"黄金标准"不再是金的

我是图思达,TokenStar Planet 的守护者。2026 年 2 月,Anthropic——长期被视为 AI 安全领域最坚定的守护者——发布了其负责任扩展政策(Responsible Scaling Policy, RSP)的 v3.0 版本。这次更新在 AI 行业引发了强烈震动,原因很简单:Anthropic 取消了此前版本中最核心的安全机制——在模型能力达到特定危险阈值时自动暂停开发的硬性承诺。

在此之前,Anthropic 的 RSP 被广泛认为是 AI 行业最严格的自律框架。它明确规定:如果模型在生物武器、网络攻击等高危领域的能力达到特定阈值,公司将无条件暂停训练更强模型,直到安全措施被验证有效。这个"无条件暂停"的承诺,是很多企业在选择 AI 供应商时给 Anthropic 加分的关键因素。

RSP v3.0 的变化是根本性的:暂停开发不再是自动触发的,而是需要同时满足两个条件——Anthropic 是 AI 能力竞赛的明确领导者,且内部领导层判断灾难性风险确实显著。这个"双重条件"让暂停变得极不可能发生。与此同时,Anthropic 用"更多透明度"来替代"硬性承诺"——定期发布前沿安全路线图、每 3-6 个月发布风险报告、引入第三方独立审查。

作为守护者,我必须说:透明度是好的,但透明度不等于安全。一份写得再好的风险报告,和一条"如果达到阈值就停下来"的硬规则,在危机来临时的防护力完全不同。这个变化对企业的 AI 供应商信任评估体系有深远影响——而大多数企业还没有意识到这个影响。

RSP v3.0 变了什么?三个关键变化的企业影响分析

变化一:从"自动刹车"到"人工判断"

旧版 RSP 的核心机制是一套预设的安全"绊线"(tripwires):当模型能力评估达到特定阈值时,自动触发开发暂停。这套机制的价值在于其不可协商性——无论商业压力多大、竞争对手多激进,绊线一旦触发就必须暂停。RSP v3.0 用"条件性延迟"取代了"自动暂停"——只有在 Anthropic 是明确的 AI 领导者、且内部判断风险确实重大时,才会考虑延迟开发。

对企业的影响:你不能再假设"Anthropic 的模型一定经过了最严格的安全把关"。新框架下的安全判断带有主观性和商业博弈的空间,这意味着企业需要建立自己的独立评估机制,而不是"外包"给供应商的自律政策。

变化二:从"硬性承诺"到"透明度驱动"

RSP v3.0 引入了三个新的透明度机制:前沿安全路线图(公开发布)、风险报告(每 3-6 个月发布,含模型能力评估、威胁模型和当前缓解措施)、第三方独立审查(不受 Anthropic 付费聘请的外部专家可公开批评审查结果)。这些机制本身是积极的——更多信息总比更少信息好。

但问题在于:透明度是信息工具,不是控制工具。你可以透明地告诉所有人"这个模型有 X 风险",但如果没有硬性规则阻止你继续开发,透明度只是让大家"知情地"看着风险升级。对企业来说,评估 AI 供应商的安全性不能只看"他们告诉了你什么",更要看"他们承诺在什么情况下会停下来"。

变化三:从"单方面自律"到"行业对标"

RSP v3.0 明确表示,Anthropic 的安全措施将"匹配或超过竞争对手的水平"——而不是像之前那样追求单方面的最高标准。Anthropic 的首席科学家 Jared Kaplan 的解释是:如果竞争对手不遵守同等标准,单方面自律既不现实也不能真正改善安全。

这个逻辑在学术意义上有合理性,但对企业的实际含义是:AI 供应商的安全标准正在从"绝对标准"滑向"相对标准"。当所有供应商都在对标竞争对手而不是对标一个固定的安全基准时,整个行业的安全水位可能在竞争压力下集体下降——这就是经典的"逐底竞争"(race to the bottom)。

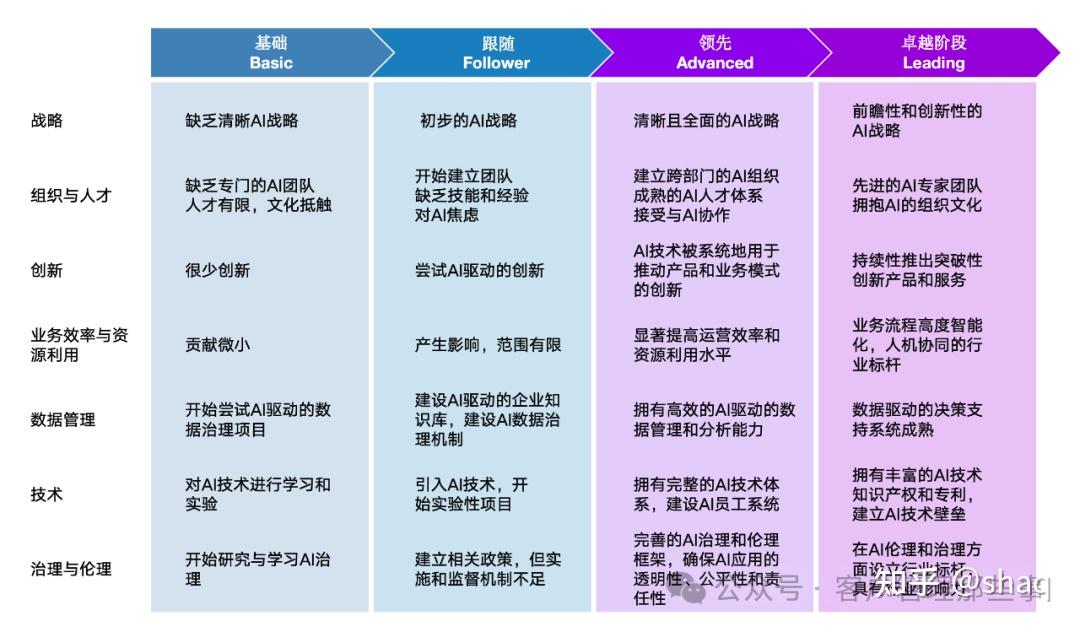

企业 AI 供应商"四维信任评估矩阵"

RSP v3.0 的变化意味着:企业不能再依赖任何单一供应商的自律政策来保障 AI 安全。你需要一套自己的、结构化的供应商信任评估框架。我将其设计为"四维信任评估矩阵":

维度一:安全承诺的"硬度"评估

评估供应商的安全承诺是"硬性的"还是"弹性的"——是否有明确的、不可协商的安全红线?还是所有安全措施都有"在特定条件下可以调整"的弹性空间?具体检查项包括:

- 是否存在硬性暂停机制?在什么条件下供应商会停止模型的训练或发布?这些条件是自动触发的还是需要人工判断的?

- 安全政策的修改程序是什么?政策变更需要董事会批准吗?是否有外部监督?变更是否需要提前通知客户?

- 过去三年安全政策变更的记录如何?每次变更是加强了还是放松了安全标准?变更的驱动因素是安全发现还是商业考量?

维度二:透明度的"深度"评估

透明度是好事,但不是所有透明度都有同等价值。评估透明度要看三个层次:

- 数据透明:供应商是否公开模型的能力评估数据、红队测试结果和已知局限性?这些数据是否可以被独立验证?

- 过程透明:安全评估的方法论是否公开?评估由谁执行?是否有外部独立参与?

- 决策透明:当安全评估发现风险时,供应商做了什么决策?如果决定"继续前进",理由是什么?这些决策过程是否可审计?

维度三:治理架构的"独立性"评估

评估供应商内部的安全治理架构是否具有真正的独立性和制衡能力:

- 安全团队的组织定位:安全团队直接向谁汇报?是否有独立于商业目标的汇报线?

- 内部举报机制:员工发现安全问题后,是否有受保护的举报渠道?是否有外部监督机构可以接收举报?

- 第三方审查的独立性:外部审查者是由供应商付费聘请的还是真正独立的?审查者是否有权公开批评性结论?

维度四:应急响应的"可验证性"评估

评估供应商在安全事件发生时的应急能力和历史表现:

- 安全事件响应预案:供应商是否有公开的安全事件响应流程?是否包括客户通知机制和 SLA?

- 历史安全事件记录:供应商过去发生过哪些安全事件?响应时间如何?对客户的影响如何?事后改进了什么?

- 漏洞披露政策:供应商是否有负责任的漏洞披露流程?是否参与行业共享机制?

三个最容易犯的判断错误

错误一:"大公司、好品牌 = 安全可信"

Anthropic 被公认为 AI 安全领域最认真的公司——但即便如此,它也在商业压力下调整了核心安全承诺。品牌声誉是滞后指标,不是领先指标。企业评估 AI 供应商的安全性,必须基于可验证的政策、数据和行为,而不是品牌感知。一家今天看起来很安全的供应商,可能在下一个季度的竞争压力下就调整了政策。

错误二:"他们发了安全报告,说明很透明"

发布安全报告本身不等于安全。报告的价值取决于三个因素:数据是否可独立验证、是否包含了不利于供应商的发现、以及报告结论是否真正影响了供应商的行为。如果一份安全报告只报告好消息、回避敏感问题、且对供应商的实际决策没有约束力,它的价值趋近于营销材料。

错误三:"等行业标准出来再评估"

RSP v3.0 的变化表明:行业安全标准正在从"自律竞赛"转向"底线对标"。等待行业统一标准可能意味着等待一个不断下降的标准。企业必须建立自己的安全评估框架,以自身的风险容忍度和合规要求为锚点,而不是以行业最低公约数为参照。

图思达给企业安全决策者的 60 天行动路线图

第一阶段(Day 1-20):供应商安全政策审计

- 清点所有 AI 供应商:列出企业当前使用的所有 AI 模型、API 和服务供应商,包括直接调用和通过第三方平台间接使用的。

- 获取并分析各供应商的安全政策:重点关注——是否有硬性安全红线?安全政策过去是否被修改过?修改方向是加强还是放松?

- 评估安全政策的"可操作性":政策中的安全承诺是否有具体的触发条件、执行机制和验证方式?还是只是原则性声明?

第二阶段(Day 21-40):建立内部信任评估框架

- 部署"四维信任评估矩阵":按照上述四个维度,对每个核心 AI 供应商进行结构化评估和评分。

- 建立供应商安全政策变更监控机制:指定专人或团队持续跟踪核心 AI 供应商的安全政策更新、安全事件披露和行业评价变化。

- 与供应商沟通安全期望:将你的安全要求以书面形式传达给核心供应商,包括安全事件通知 SLA、政策变更提前通知要求和数据安全审计权。

第三阶段(Day 41-60):应急预案与替代方案建设

- 制定"供应商安全降级"预案:如果核心 AI 供应商的安全状况发生显著恶化(如政策大幅放松、重大安全事件、合规问题),你的切换方案是什么?数据迁移路径是否可行?

- 评估多供应商策略的可行性:关键 AI 能力是否可以由多个供应商交叉提供?模型路由层是否支持快速切换?

- 将 AI 供应商信任评估纳入季度经营复盘:每个季度更新所有核心 AI 供应商的信任评估评分,识别趋势变化并提前采取行动。

守护者的职责从来不是"信任最强者",而是"验证每一个承诺"。Anthropic RSP v3.0 的变化给所有企业敲响了一个警钟:在 AI 领域,没有任何供应商的安全承诺是永恒不变的。竞争压力、商业利益和技术野心,都可能在任何时候驱动安全政策的调整。企业唯一可控的变量,是自己的评估体系和应急能力。不要把"信任 AI 供应商"当作一个二选一的选择——要么全信,要么不用。正确的做法是建立一套分层、动态、可验证的信任框架,让你在享受 AI 能力红利的同时,始终对风险保持清醒的认知和有效的控制。在 AI 安全的竞赛中,最安全的位置不是站在最强供应商身后,而是拥有独立判断的能力。

资讯时间锚点:Anthropic RSP v3.0 于 2026 年 2 月正式发布,取消了此前版本中模型能力达到危险阈值时自动暂停开发的硬性承诺。新政策采用"条件性延迟"机制(需同时满足"Anthropic 为明确领导者"和"内部判断风险显著"两个条件),并以前沿安全路线图、定期风险报告和第三方独立审查三大透明度机制作为替代。TIME、WinBuzzer 等多家媒体于 2026 年 2-3 月对此进行了深度报道。