报告核心内容

监管敏感行业需要什么样的 AI 机制

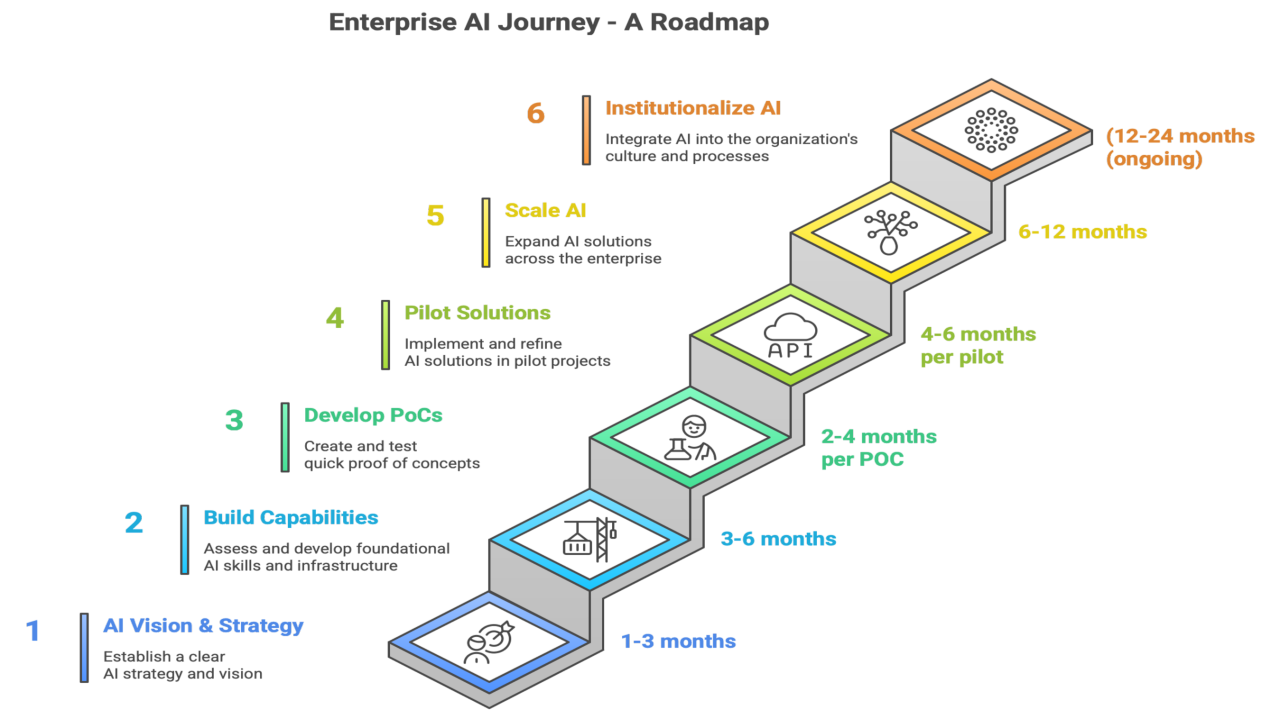

金融机构面临的挑战不是“能否用 AI”,而是“在什么边界内使用 AI 才能稳定通过内控与监管要求”。报告表明,能顺利上线的团队通常会把场景风险等级、输出责任归属与审计要求在立项阶段一次性定义清楚。

这意味着,金融机构做 AI 项目时,制度设计不应晚于技术设计。制度和技术必须同步建模,才能避免试点成功却无法转生产。

明确高、中、低风险场景的不同上线标准

为关键输出绑定责任岗位与审批动作

将日志留痕、版本记录和知识来源纳入制度文件

四类最值得优先落地的场景

报告建议金融机构优先从知识问答、内部检索、客服辅助与合规材料生成等“低外部责任、高效率价值”场景入手。这些场景既能快速释放生产力,又能在相对可控的边界内积累经验。

相比之下,自动授信、直接投资建议和自动拒赔等高风险场景,更适合在治理体系成熟后分阶段引入。

内部知识助手:先从制度、产品与流程文档开始

客服辅助:AI 负责建议,人类客服负责最终响应

材料生成:必须接入模板控制、版本锁定与审计水印

治理不是减速器,而是规模化前提

多数机构在初期担心治理要求会拖慢项目推进,但报告发现,真正影响推进速度的往往不是治理本身,而是治理缺失导致的返工。没有统一口径的知识资产、没有清晰责任边界的流程,会让项目上线后频繁触发临时补洞。

因此,把治理做成平台化能力,反而会提升后续项目复制效率。

建立统一的场景准入清单与风险分级表

把模型、知识和流程审计整合进同一看板

形成“试点—复盘—审查—复制”的固定节奏